Anthropic의 Model Context Protocol(MCP) : 사용 가이드

오늘은 Anthropic에서 새롭게 발표한 Model Context Protocol(MCP)에 대해 자세히 알아보려고 합니다. AI에 관심이 있는 분이라면 꼭 알아두어야 할 새로운 기술이니 차근차근 살펴보겠습니다.

Introducing the Model Context Protocol

The Model Context Protocol (MCP) is an open standard for connecting AI assistants to the systems where data lives, including content repositories, business tools, and development environments. Its aim is to help frontier models produce better, more relevan

www.anthropic.com

# MCP가 뭔가요?

MCP(Model Context Protocol)는 Anthropic이 새롭게 발표한 혁신적인 오픈 소스 프로토콜입니다. 이는 AI 어시스턴트가 다양한 데이터 소스와 직접 상호작용할 수 있게 해주는 표준화된 연결 방식입니다. 특히 주목할 만한 점은 이 프로토콜이 특정 AI 모델에 국한되지 않는다는 것인데 Anthropic의 Claude뿐만 아니라 모든 AI 모델이 이 프로토콜을 통해 비즈니스 도구, 콘텐츠 저장소, 개발 환경 등과 연동될 수 있습니다. 이미 Block, Apollo를 비롯한 여러 기업들이 MCP를 자사 시스템에 도입했으며, Replit, Codium, Sourcegraph 같은 개발 도구 회사들도 MCP 도입을 진행 중이라고 합니다.

좀 더 쉽게 설명하자면:

- 지금까지의 AI: "저는 학습된 데이터만 알고 있어요"

- MCP 적용 후의 AI: "제가 직접 웹 서칭, 구글 드라이브, 슬랙, GitHub 등을 검색해서 최신 정보를 알려드릴 수 있어요!"

아래는 실제 MCP를 적용 전과 후의 답변 결과입니다.

- 기존 방식:

- 유저: "Claude, 비트코인의 현재 가격이 얼마인지 알려줘"

- Claude: "죄송합니다. 실시간 가격 정보에 접근할 수 없어요"

- MCP 사용:

- 유저: "Claude, 비트코인의 현재 가격이 얼마인지 검색해서 알려줘"

- Claude: "Brave Search로 검색해 보니, 현재 비트코인 가격은 $51,234이고, 지난 24시간 동안 3.2% 상승했네요. 이 정보를 파일로 저장해 드릴까요?"

OpenAI도 얼마 전 ChatGPT에 'Work with Apps'라는 유사한 기능을 발표했습니다.

ChatGPT Plus와 Team 사용자들은 Xcode, VS Code, JetBrains IDE 등 다양한 코딩 앱과 연동하여 더 정확한 답변을 받을 수 있게 되었습니다. 하지만 OpenAI는 이 기술을 오픈 소스로 공개하지 않고 특정 파트너들과의 협력을 통해 제한적으로 테스트하고 있다는 점이 Anthropic의 접근방식과 다릅니다.

# MCP 시작하기: 따라 하기 가이드

1단계: Claude Desktop 앱 설치

- Anthropic 웹사이트에서 다운로드

- 계정 로그인

2단계: 설정 파일 만들기

# Library/Application Support/Claude 폴더로 이동 cd ~/Library/Application\ Support/Claude # config 파일 생성 touch claude_desktop_config.json

3단계: 서버 설정하기 (Brave Search + Filesystem)

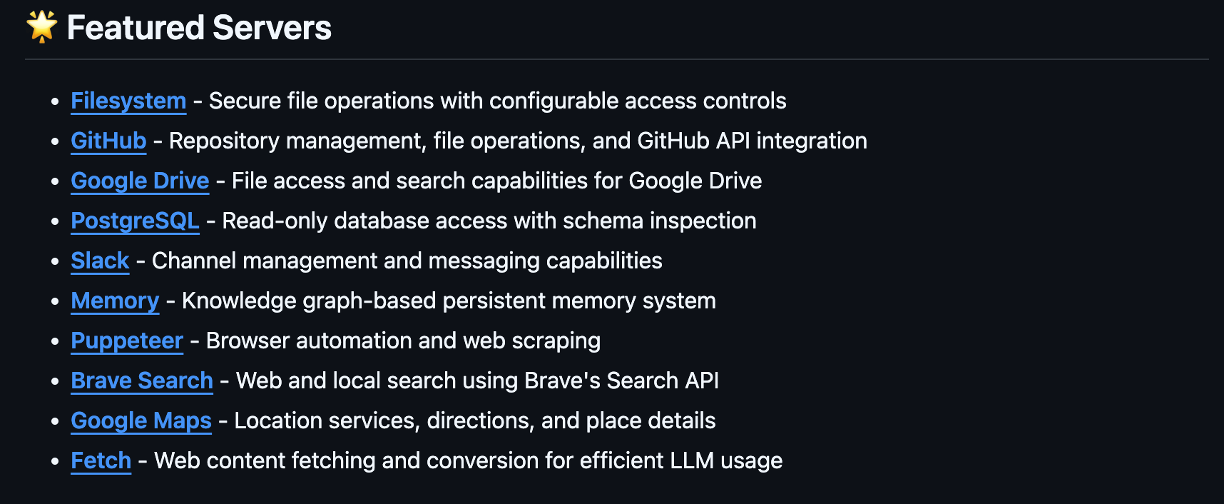

MCP에서는 다양한 서버들을 지원하고 있습니다. 파일 시스템, GitHub, Google Drive, PostgreSQL, Slack 등 정말 많은 서버들이 있는데요. 오늘은 그중에서 가장 간단하게 테스트해 볼 수 있는 Brave Search를 이용하여 웹 검색도 하고 결과를 로컬 파일로 저장할 수 있도록 두 가지 서버를 함께 설정해 보겠습니다.

Brave Search API 키 발급받기 (기존이 이미 발급한 API 키가 있다면 Skip)

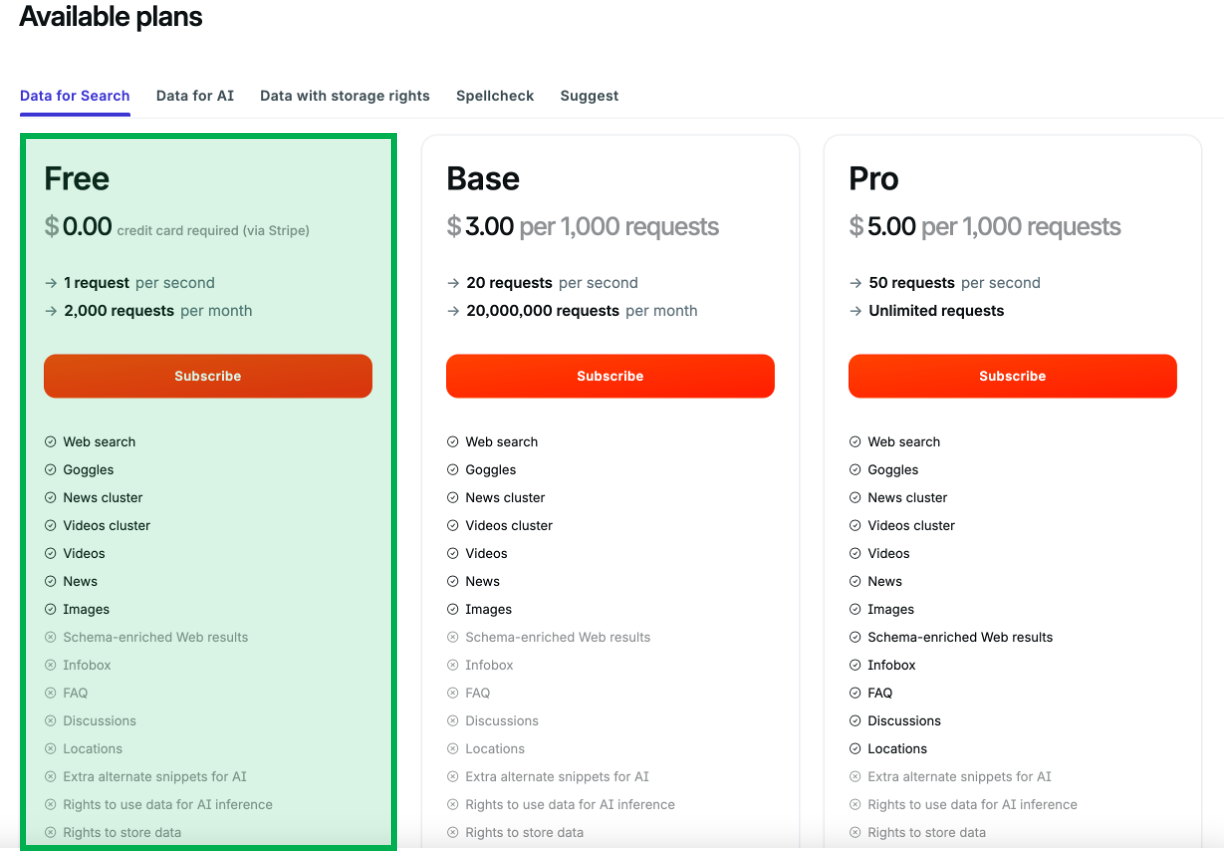

Brave Search API는 세 가지 요금제를 제공하고 있습니다. 우리는 테스트를 위해 무료 플랜을 사용할 건데요, 무료 플랜으로도 충분히 테스트해 볼 수 있습니다.

API 키 발급 순서

- https://brave.com/search/api/ 접속

- 'Free' 플랜의 'Subscribe' 버튼 클릭

- API 키 발급받기

파일 시스템 설정

- /Users/사용자이름/Desktop: 추가로 접근을 허용할 경로

- 경로는 여러 개 추가 가능

설정 파일 구성하기

앞서 만든 claude_desktop_config.json 파일을 열고 다음과 같이 작성합니다.

{ "mcpServers": { "brave-search": { "command": "npx", "args": [ "-y", "@modelcontextprotocol/server-brave-search" ], "env": { "BRAVE_API_KEY": "YOUR_API_KEY_HERE" } }, "filesystem": { "command": "npx", "args": [ "-y", "@modelcontextprotocol/server-filesystem", "/Users/username/Desktop", "/path/to/other/allowed/dir" ] } } }

💡 Tip: 무료 플랜은 초당 1회 요청만 가능하니, 검색 요청을 너무 빠르게 연속해서 하지 않도록 주의해 주세요!

# 테스트하기

설정이 완료되면 Claude Desktop 앱의 채팅 인터페이스에서 Available MCP Tools 버튼이 보여야 합니다. 이 버튼이 보인다면 MCP가 정상적으로 설정된 것입니다.

이제 실제로 테스트를 해보겠습니다.

웹 검색 테스트

"비트코인 가격 정보를 검색하고 bitcoin-price.md 파일로 저장해줘"처음 실행할 때는 Brave Search 사용 권한을 요청하는 팝업이 뜰 수 있습니다. 이를 허용해 주세요.

파일 시스템 테스트

이어서 파일을 저장하기 위한 명령을 수행합니다. file system 역시 사용 권한을 요청하는 팝업이 뜹니다. 이를 허용해 주세요.

Brave Search로 검색하고 후 정보를 정리하여 지정된 MCP 폴더(/Users/yunwoong/Desktop/MCP)에 markdown 파일로 저장합니다.

MCP는 우리가 테스트해 본 Brave Search와 파일 시스템 외에도 다양한 서버들을 지원합니다. Google Drive로 문서를 검색하거나, Slack으로 메시지를 주고받고, GitHub 저장소를 관리하는 등 다양한 작업이 가능합니다.

더 멋진 점은 누구나 자신만의 MCP 서버를 만들 수 있다는 것입니다. TypeScript나 Python을 사용해 원하는 기능을 가진 서버를 개발할 수 있어요. 사내 시스템 연동이나 특별한 API 연동 등 필요한 기능을 직접 구현할 수 있습니다. Model Context Protocol 문서를 참고하시기 바랍니다.

MCP는 AI의 새로운 장을 열어가는 중요한 기술입니다. 이제 AI 어시스턴트가 우리가 실제로 사용하는 도구들과 직접 소통할 수 있게 되었죠. 아직 초기 단계지만, AI 통합의 미래를 보여주는 중요한 이정표가 될 것입니다.

'Tech & Development > AI' 카테고리의 다른 글

| AWS Bedrock으로 구현한 Contextual Retrieval (0) | 2024.12.04 |

|---|---|

| Claude의 새로운 기능: 맞춤형 응답 스타일 설정 (0) | 2024.11.28 |

| AI 에이전트 시작하기: LangGraph 개념과 실습 (0) | 2024.11.26 |

| LLM의 토큰(Token): AI의 글자 단위 (0) | 2024.11.10 |

| Anthropic Computer Use 가이드: 사용 후기 (1) | 2024.10.26 |

댓글

이 글 공유하기

다른 글

-

AWS Bedrock으로 구현한 Contextual Retrieval

AWS Bedrock으로 구현한 Contextual Retrieval

2024.12.04 -

Claude의 새로운 기능: 맞춤형 응답 스타일 설정

Claude의 새로운 기능: 맞춤형 응답 스타일 설정

2024.11.28 -

AI 에이전트 시작하기: LangGraph 개념과 실습

AI 에이전트 시작하기: LangGraph 개념과 실습

2024.11.26 -

LLM의 토큰(Token): AI의 글자 단위

LLM의 토큰(Token): AI의 글자 단위

2024.11.10

댓글을 사용할 수 없습니다.